Mistral公司隆重推出了其最新的开源编码模型——Codestral 25.01。这款升级版模型是广受欢迎的Codestral的重大改进,在架构上进行了深度优化,显著提升了性能,成为重量级编码领域的佼佼者。

性能提升

与前代版本相比,Codestral 25.01的速度提升了惊人的两倍,为开发者带来了更高效的编码体验。它延续了原版Codestral的低延迟和高频率操作特性,并支持代码校正、测试生成和中间填充等多种任务。

基准测试结果令人振奋。Codestral 25.01在Python编码测试中表现卓越,在HumanEvalIDE插件以及本地部署工具轻松访问Codestral 25.01。Mistral还提供了通过Google Vertex和Mistralla Plateforme访问API的方式,进一步拓展了模型的应用场景。目前,该模型已在Azure AI Foundry上提供预览版,并计划不久后登陆Amazon Bedrock平台,为更多用户带来便利。

开源代码模型的领跑者

自去年发布以来,Mistral的Codestral系列已成为开源代码模型的领跑者。最初的Codestral模型拥有220亿参数,支持超过80种编程语言,在编码性能上超越了许多同类竞品。此后,Mistral又推出了基于Mamba架构的Codestral-Mamba模型,这款模型能够处理更长的代码序列,满足更广泛的输入需求。

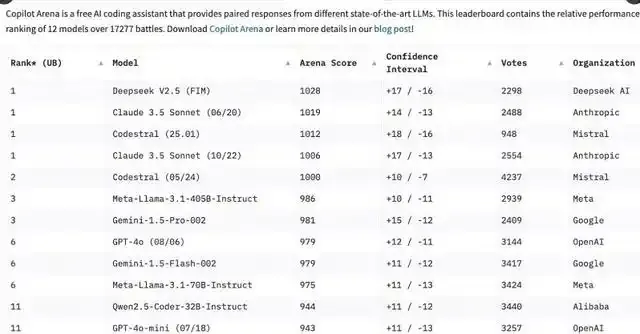

Codestral 25.01迅速引起了开发者的强烈关注,在短短数小时内便在Copilot Arena排行榜上名列前茅。这一趋势表明,专为编码任务设计的模型正在逐渐成为开发人员的首选。尤其在编码领域,相比于多功能的通用模型,专注型编码模型的需求正在日益增长。

与通用模型的比较

虽然像OpenAI的O3和Anthropic的Claude等通用模型也能执行编码任务,但经过专门优化的编码模型往往在性能上表现得更为出色。过去一年中,多家公司纷纷推出了针对编码的专用模型,如阿里巴巴的Qwen 2.5-Coder和中国DeepSeekCoder。后者更是成为首个超越Turbo的编码模型。

对于通用模型还是专注模型,开发者仍有争议。但编码模型的迅速崛起无疑体现了市场对于高效、精准编码工具的巨大需求。凭借其专为编码任务训练的优势,Codestral 25.01无疑将在未来的编码领域占据重要地位,为开发者带来更加优质的编码体验。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...