近日,DeepSeek团队再次震撼开源社区,推出了专为混合专家系统(MoE)和专家并行(EP)设计的通信库——DeepEP。这一开源项目不仅支持FP8低精度运算,还特别针对Hopper GPU进行了优化,旨在提供低延迟和超高速的训练与推理能力。😲

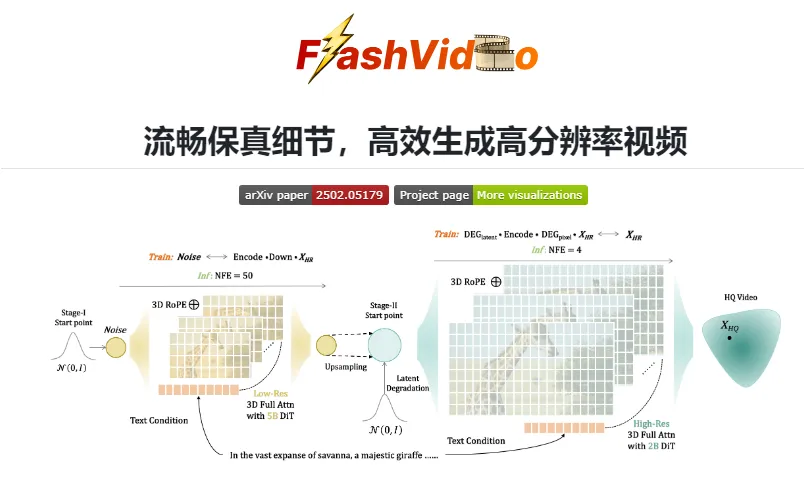

DeepEP的核心优势在于其高效优化的all-to-all通信能力,这对于MoE模型的训练和推理至关重要。它通过高吞吐量和低延迟的GPU全互联内核,实现了所谓的“调度”和“组合”操作,极大地提升了模型的处理速度和效率。🚀

特别值得一提的是,DeepEP支持FP8格式的低精度运算,这不仅减少了计算资源的消耗,还加快了数据处理速度。开源仅一小时,GitHub上的星标数便突破了1.5k,显示出社区对这一技术的高度认可和期待。🌟

DeepEP还引入了一种基于回调机制的通信-计算重叠方法,这种方法不占用任何流式多处理器(SM)资源,进一步优化了性能。对于对延迟敏感的推理解码任务,DeepEP提供了一组纯RDMA实现的低延迟内核,确保数据处理的最小延迟。🔧

DeepSeek团队在开发过程中还意外发现了一条未在官方文档中列出的特殊指令,这条指令在特定硬件上使用时,可以显著提升性能。这一发现不仅展示了DeepSeek团队的技术实力,也为未来的AI模型优化提供了新的思路。🛠️

DeepEP的开源不仅是技术上的一个重大突破,也为AI领域的大规模模型训练和推理提供了新的解决方案。随着更多开发者的参与和优化,DeepEP有望成为AI开发者的重要工具,推动AI技术的进一步发展。🌍

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...